Dortmund, 23. Mai 2024

Künstliche Intelligenz (KI) hat sich in den vergangenen Jahren zu einem unverzichtbaren Werkzeug der Gesundheitsforschung entwickelt. Um große Datensätze zu analysieren, setzen Forschende dabei vermehrt auf Machine Learning (ML). Dieser Teilbereich der KI ermöglicht Computern, aus Daten zu lernen und Muster in ihnen zu erkennen. So können Forschende komplexe Zusammenhänge, etwa zwischen Krankheitsverläufen und Symptomen, besser verstehen. Klinische Daten sind jedoch häufig vielschichtig. Veränderliche und untereinander verknüpfte Datenpunkte, wie die Werte aus aufeinanderfolgenden Bluttests, bringen Standard-ML-Algorithmen schnell an ihre Grenzen. Forscher des ISAS, der Otto-von-Guericke Universität Magdeburg, der Universität Bielefeld und des Deutschen Zentrum für Hochschul- und Wissenschaftsforschung in Hannover setzen deswegen gemeinsam mit Kooperationspartnern aus den Universitätsklinika Leipzig und Greifswald auf eine alternative ML-Methode. Am Beispiel eines Modells zur Vorhersage einer Sepsis (Blutvergiftung), konnte das Team zeigen: Nicht nur die Daten selbst, sondern auch die Verbindungen zwischen den Datenpunkten liefern wichtige Informationen für eine frühzeitige Diagnose.

In der klinischen Praxis herrscht oft ein Wettlauf gegen die Zeit. Um Erkrankungen entsprechend behandeln zu können, ist es deswegen essenziell, sie früh zu diagnostizieren. So zum Beispiel bei einer Sepsis (s. Infobox). Die lebensgefährliche Infektion schreitet oft so schnell voran, dass sich mit jeder Stunde, in der nicht behandelt wird, das Sterberisiko der Patient:innen um rund acht Prozent erhöht1. Im Anfangsstadium ist eine sich anbahnende Sepsis oft jedoch nur schwer erkennbar. Besteht ein Verdacht, können Ärzt:innen zwar zunächst mit einem Breitbandantibiotikum behandeln. Doch die spezifische Diagnose mittels Bakterienkultur oder Fieberbildbestimmung kostet Zeit. Steht final fest, wie und gegen welches Bakterium behandelt werden muss, kämpfen Mediziner:innen häufig gegen eine schon fortgeschrittene und schwer zu behandelnde Entzündung.

SEPSIS

Sepsis, auch bekannt als Blutvergiftung, ist eine tödliche Erkrankung, die jährlich mehr Menschenleben kostet als Brust-, Prostata- und Darmkrebs zusammen2. Die Erkrankung beginnt, wenn das Immunsystem es nicht schafft, einen lokalen Infekt einzugrenzen und sich Boten- und Giftstoffe über den Blutkreislauf verbreiten. Der Körper reagiert, indem er Leukozyten (weiße Blutkörperchen) ausschickt, um die Pathogene (Erreger) zu bekämpfen. Das kann dazu führen, dass sich die Blutgefäße weiten. Weil damit der Blutdruck fällt, werden lebenswichtige Organe wie Lunge, Nieren oder Herz nicht mehr ausreichend versorgt und können in schweren Fällen versagen. Die Patient:innen geraten in einen septischen Schock. Es droht eine akute Lebensgefahr.

Machine Learning soll frühe Diagnose ermöglichen

Machine Learning (s. Infobox) könnte Ärzt:innen in Zukunft helfen, zeitkritischen Erkrankungen frühzeitig zu diagnostizieren: „Mit KI lässt sich aus dem Blutbild vorhersagen, welche Patient:innen Gefahr laufen könnten, beispielsweise eine Sepsis zu entwickeln“, sagt Prof. Dr. Robert Heyer, Leiter der Nachwuchsgruppe Mehrdimensionale Omics-Datenanalyse am ISAS. Entsprechende Modelle gebe es bereits. „Doch sie geraten an ihre Grenzen, wenn es darum geht, komplexe Zeitreihen zu berücksichtigen“, ergänzt der Forscher. Zeitreihen bestehen aus Abfolgen von Datenpunkten, die in regelmäßigen Zeitintervallen gesammelt werden. In der Klinik könnten sie beispielsweise Informationen über die Veränderung von Vitalparametern wie Blutwerte, Herzfrequenz, oder Blutzuckerspiegel von Patient:innen enthalten.

Unsere Ergebnisse unterstreichen, wie wichtig regelmäßig erhobene Daten von Patient:innen als Basisinformationen für Vorhersagemodelle in der Gesundheitsforschung sind.

Prof. Dr. Robert Heyer

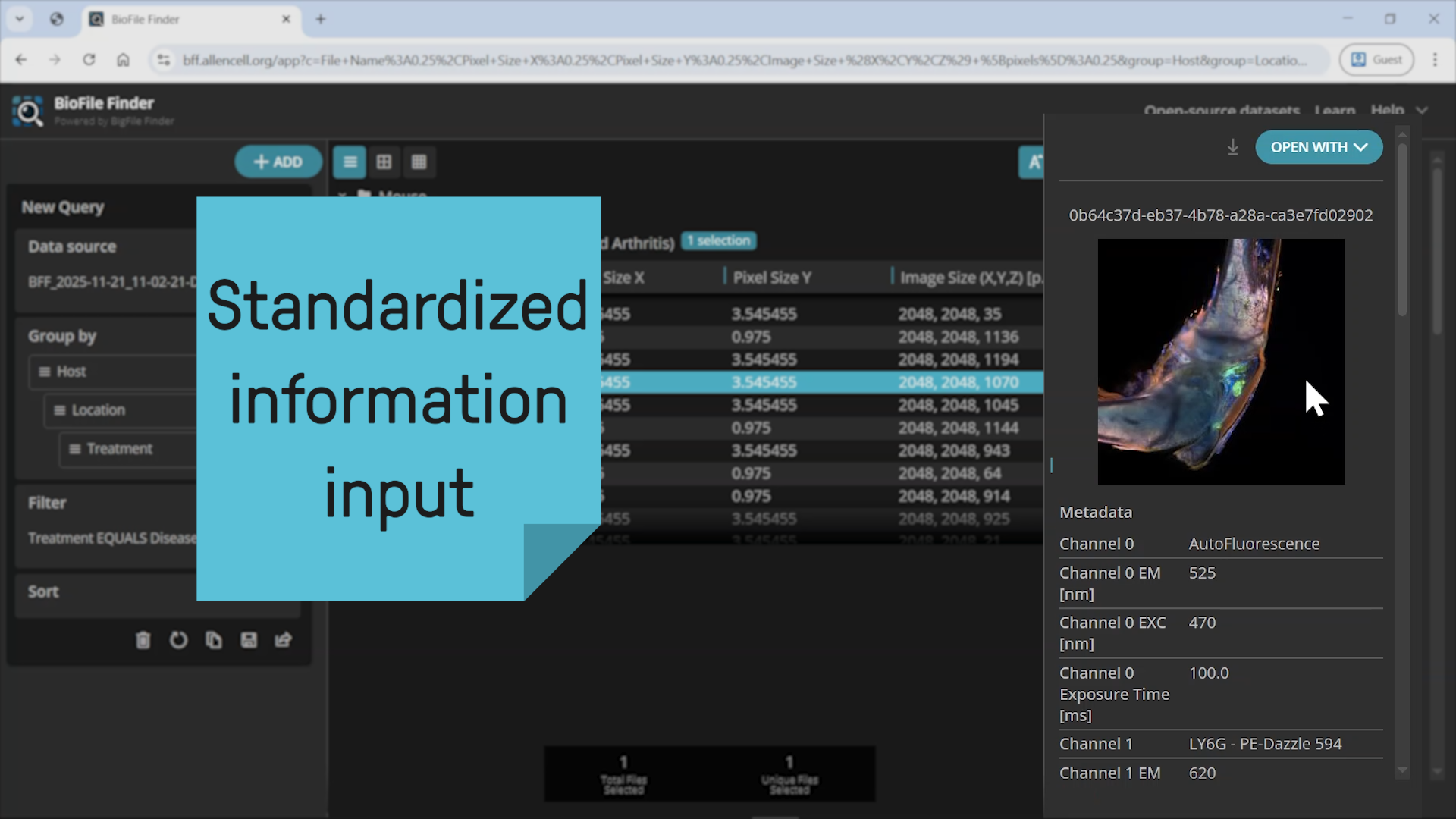

Das interdisziplinäre Forschenden-Team untersuchte die Performance einer speziellen Art von Algorithmen, genannt Graph Neural Networks (GNNs). Sie eignen sich besonders, um Daten zu analysieren, die als Graphen organisiert sind – wie etwa Zeitreihen. In einem Graph sind die Datenpunkte (Knoten) über sogenannte Kanten miteinander verbunden. Sie repräsentieren die Beziehungen der Knoten untereinander. So entstehen komplexe Netzwerkstrukturen, in denen die Knoten über ihre eigenen Informationen hinaus Informationen über ihre benachbarten Knoten berücksichtigen. Indem sie den Verknüpfungen im Datennetz folgen, entschlüsseln die GNNs wie sich unterschiedliche Faktoren gegenseitig beeinflussen und sie decken Zusammenhänge auf. „Unser Ziel war es herauszufinden, inwiefern sich GNNs für die Analyse komplexer klinischer Daten eignen und ob die Integration von Zeitreihen die Vorhersagegenauigkeit der Modelle verbessert“, berichtet Daniel Walke, Doktorand an der Otto-von-Guericke-Universität Magdeburg und Erstautor des gemeinsamen Preprints (Vorabveröffentlichung einer wissenschaftlichen Arbeit, die noch nicht im Peer-Review-Prozess begutachtet wurde).

Daniel Walke ist Doktorand in der Arbeitsgruppe Datenbanken und Software Engineering an der Otto-von-Guericke-Universität Magdeburg.

© Privat.

MACHINE LEARNING

Machine Learning (ML) ist eine Disziplin der Künstlichen Intelligenz. Computer werden mithilfe des ML so trainiert, dass sie Daten und früheren Erfahrungen selbstständig verarbeiten und sich entsprechend anpassen. Ein Beispiel für ML sind Künstliche Neuronale Netze (KNNs), die dem menschlichen Gehirn nachempfunden sind. Sie bestehen aus künstlichen Neuronen, die in Schichten angeordnet und miteinander verbunden sind. Diese Neuronen verarbeiten Eingaben, führen Berechnungen durch und geben Ausgaben aus. Durch das Trainieren des Netzwerks mit Beispieldaten kann es Muster und Zusammenhänge erkennen, um Aufgaben wie Vorhersage oder Mustererkennung zu lösen. Graph Neural Networks (GNNs) sind eine besondere Form der KNNs. Sie können zusätzlich Informationen von verknüpften Messungen berücksichtigen, was oft als "message-passing" bezeichnet wird. Für ihre Vorhersagen und Klassifizierungen nutzen GNNs die Struktur und Beziehungen (Kanten) innerhalb eines Graphen um zu verstehen, wie die Datenpunkte (Knoten) untereinander agieren und sich gegenseitig beeinflussen.

Zeitreihen verbessern die Vorhersagekraft

Als Grundlage diente den Forschenden ein Datensatz mit Informationen von über 528.000 Personen, die zwischen den Jahren 2014 und 2021 in den Pflegestationen (mit Ausnahme der Intensivpflegestation) der Universitätsklinika Leipzig und Greifswald behandelt wurden. Im Laufe ihres Aufenthalts erlitten einige von ihnen eine Sepsis, andere nicht. Mithilfe der umfassenden Daten aus Leipzig trainierten die Forschenden zunächst ihre GNNs, rückblickend die Wahrscheinlichkeit einer Sepsis vorherzusagen. Die Anwendung der GNNs auf den Datensatz aus Leipzig, sowie einen weiteren aus Greifswald zeigte ähnliche Leistungen im Vergleich zu herkömmlichen ML-Algorithmen und anderen Arten von Neuronalen Netzen. Deutlich bessere Ergebnisse erzielte die Anwendung von Zeitreihendaten mit GNNs, welche die Messungen desselben Patienten integrieren. Statt wie zuvor ähnliche Messungen verschiedener Patient:innen untereinander zu verknüpfen, stellen die Knoten jeweils vollständige Blutbilder von nur jeweils einer Person zu unterschiedlichen Zeitpunkten dar. Um die Zuverlässigkeit der Vorhersagen zu messen, nutzen Forschende die sogenannte AUROC-Kurve (Area Under the Receiver Operating Characteristic Curve). Je näher der Wert an 1 liegt, desto besser ist die Leistung des Modells. Heyer und sein Team konnten die AUROC-Werte durch Integration der Zeitreihen von weniger als 0.88 auf bis zu über 0.95 verbessern. „Dass die Zeitreihen die Zuverlässigkeit der Vorhersage so stark beeinflussen, unterstreicht, wie wichtig regelmäßig erhobene Daten von Patient:innen als Basisinformationen für Vorhersagemodelle in der Gesundheitsforschung sind“, resümiert Heyer.

Keine Blackbox: Medizin braucht Transparenz

Derzeit ist noch weitgehend ungetestet, wie gut sich GNNs wirklich in den medizinischen Alltag integrieren lassen. Eine weitere Herausforderung: „GNNs und andere komplexe ML-Algorithmen, zum Beispiel XGBoost, gelten häufig als Blackboxes, bei denen nicht nachvollziehbar ist, was im Modell passiert. Dies schränkt ihre Interpretierbarkeit und Transparenz ein, die für medizinische Anwendungen jedoch unerlässlich sind“, schreiben Heyer und seine Mit-Forschenden in ihrem Paper. Die Autoren legten deshalb Wert darauf zu verstehen, worauf die Algorithmen ihre Vorhersagen basierten. „Wir haben es deswegen nicht bei der Blackbox belassen, sondern versucht herauszufinden, was die Algorithmen von den Patient:innen-Daten gelernt haben. Wir wollten wissen, welche Faktoren hinter ihren Vorhersagen stehen“, berichtet Heyer. Ihre Analyse zeigt in puncto Sepsis: Neben der veränderlichen Zahl der weißen Blutkörperchen spielen vor allem Wechselwirkungen mit anderen Blutzelltypen eine entscheidende Rolle.

Fortschrittliche ML-Tools können potenziell unzählige Menschenleben retten – nicht nur im Fall einer Sepsis, sondern auch bei anderen Erkrankungen. So könnten GNN-Analysen von Blutbilddaten in Zukunft etwa dabei helfen, die Diagnose von Thrombosen oder Leukämie zu verbessern.

Lesetipp

Walke, D., Steinbach, D., Gibb, S., Kaiser, T., Saake, G., Ahrens, P., Broneske, D., Heyer, R.

(2023). Edges are all you need: Potential of Medical Time Series Analysis with Graph Neural Networks. PREPRINT (Version 1) available at Research Square: https://doi.org/10.21203/rs.3.rs-3573549/v1.

1 https://www.ncbi.nlm.nih.gov/pmc/articles/PMC8210984/

2 https://www.england.nhs.uk/blog/beating-sepsis-with-early-detection-and-prompt-treatment/

(Cheyenne Peters/ Ute Eberle)